SLAM algorithm of dynamic environment based on semantic prior and geometric constraints

-

摘要:

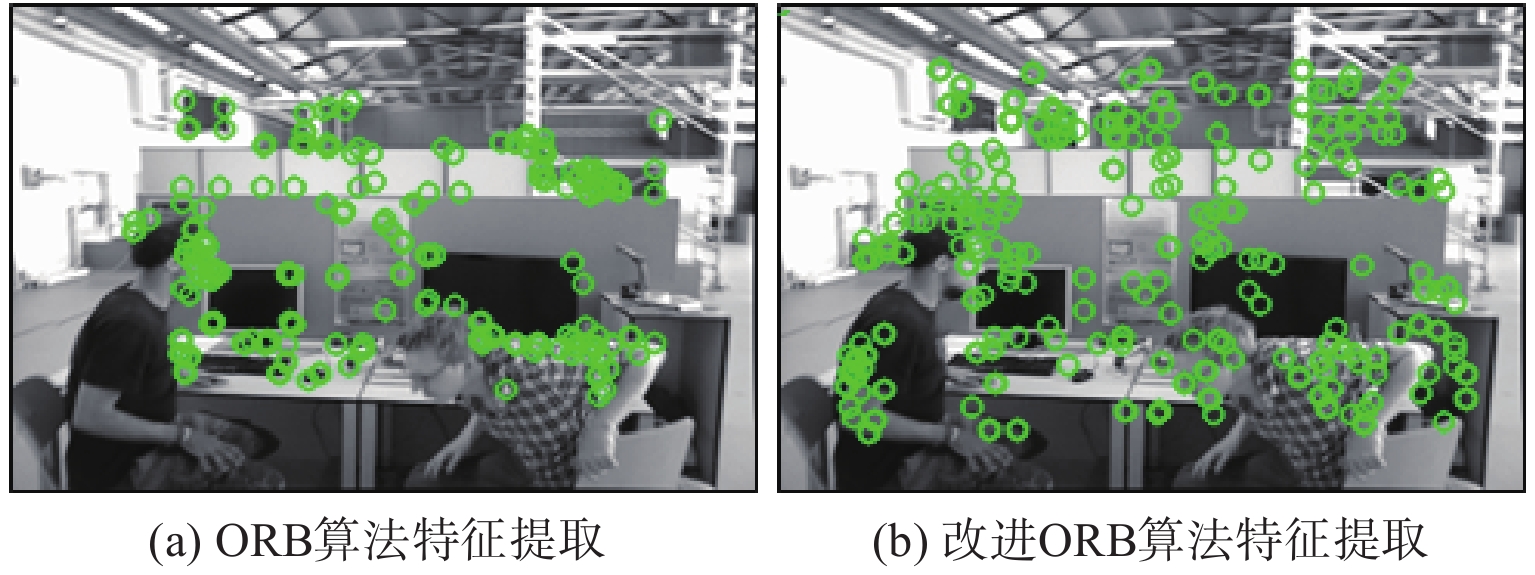

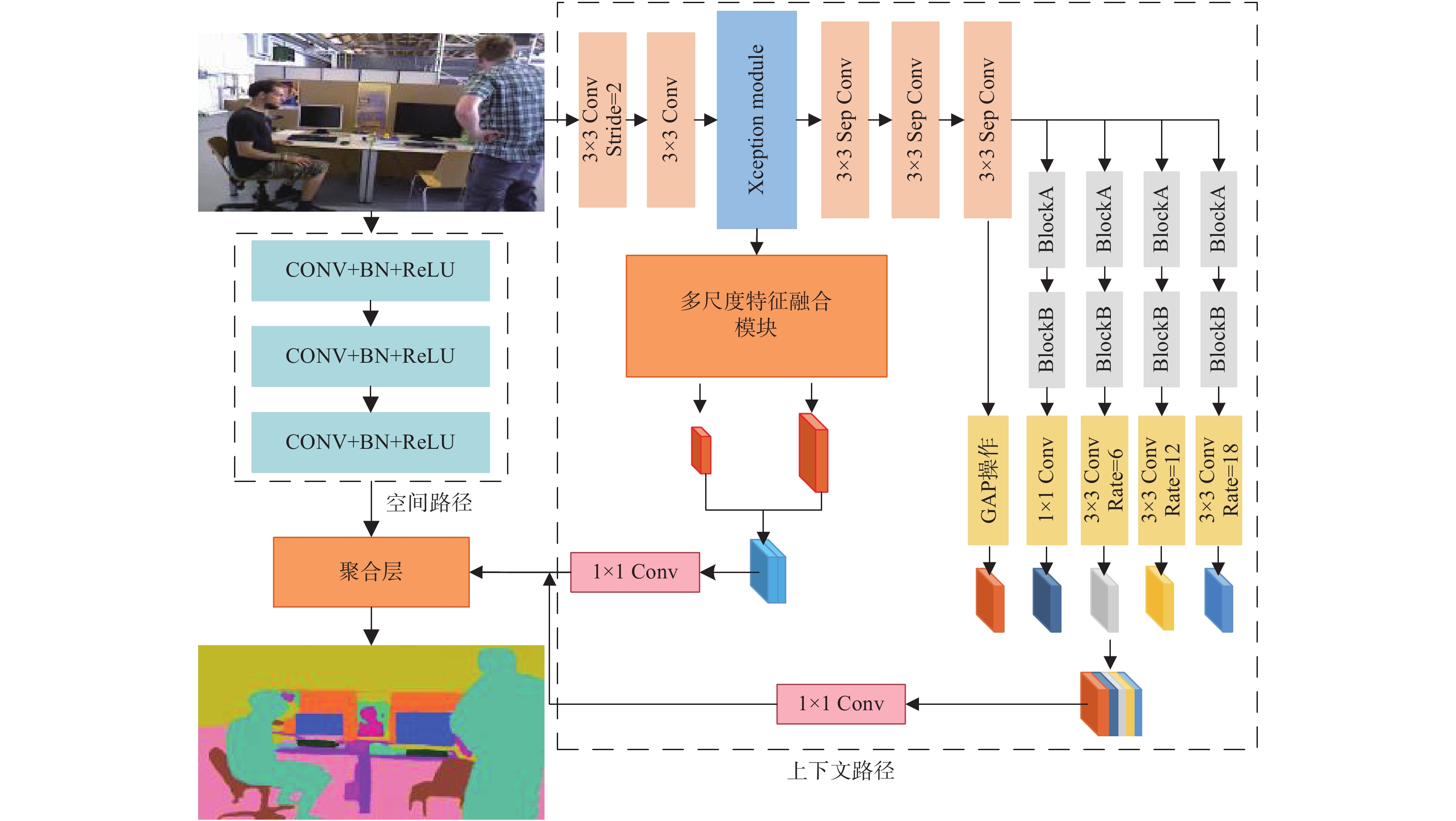

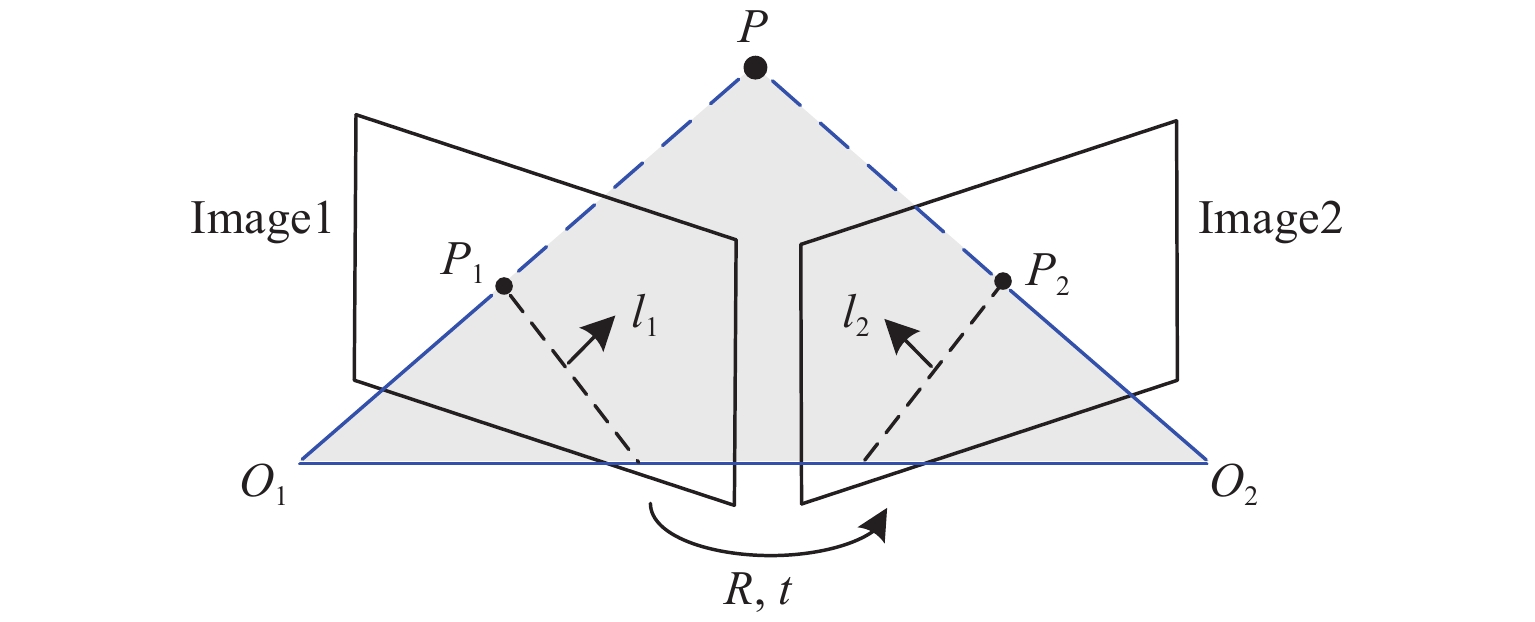

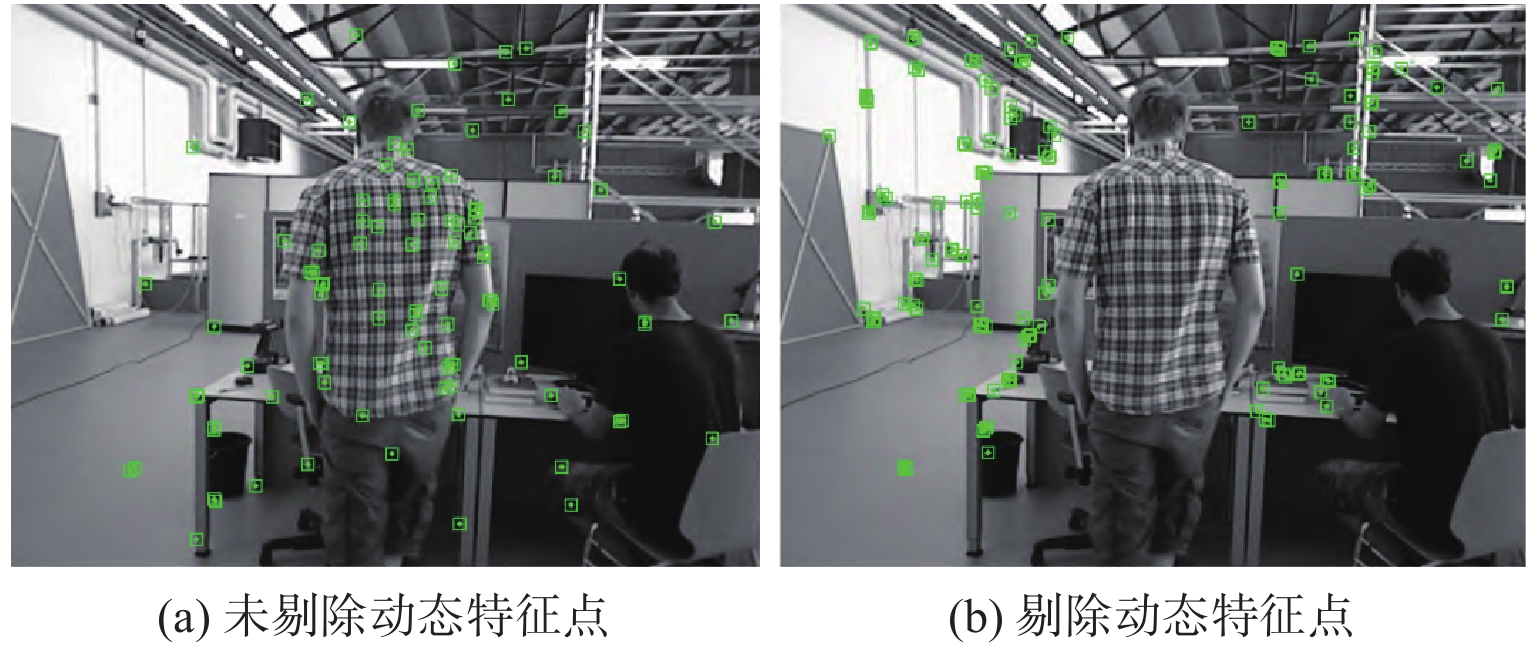

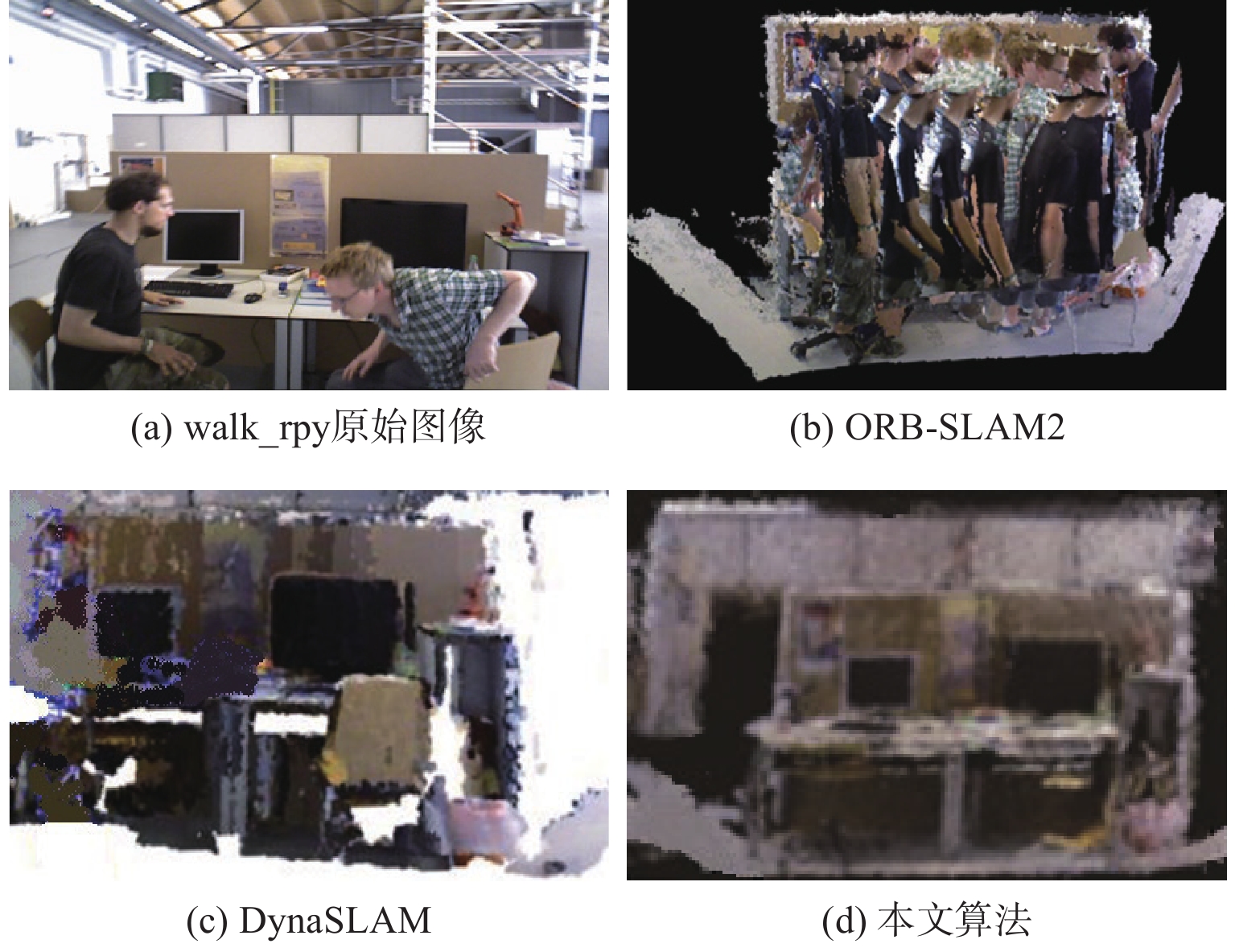

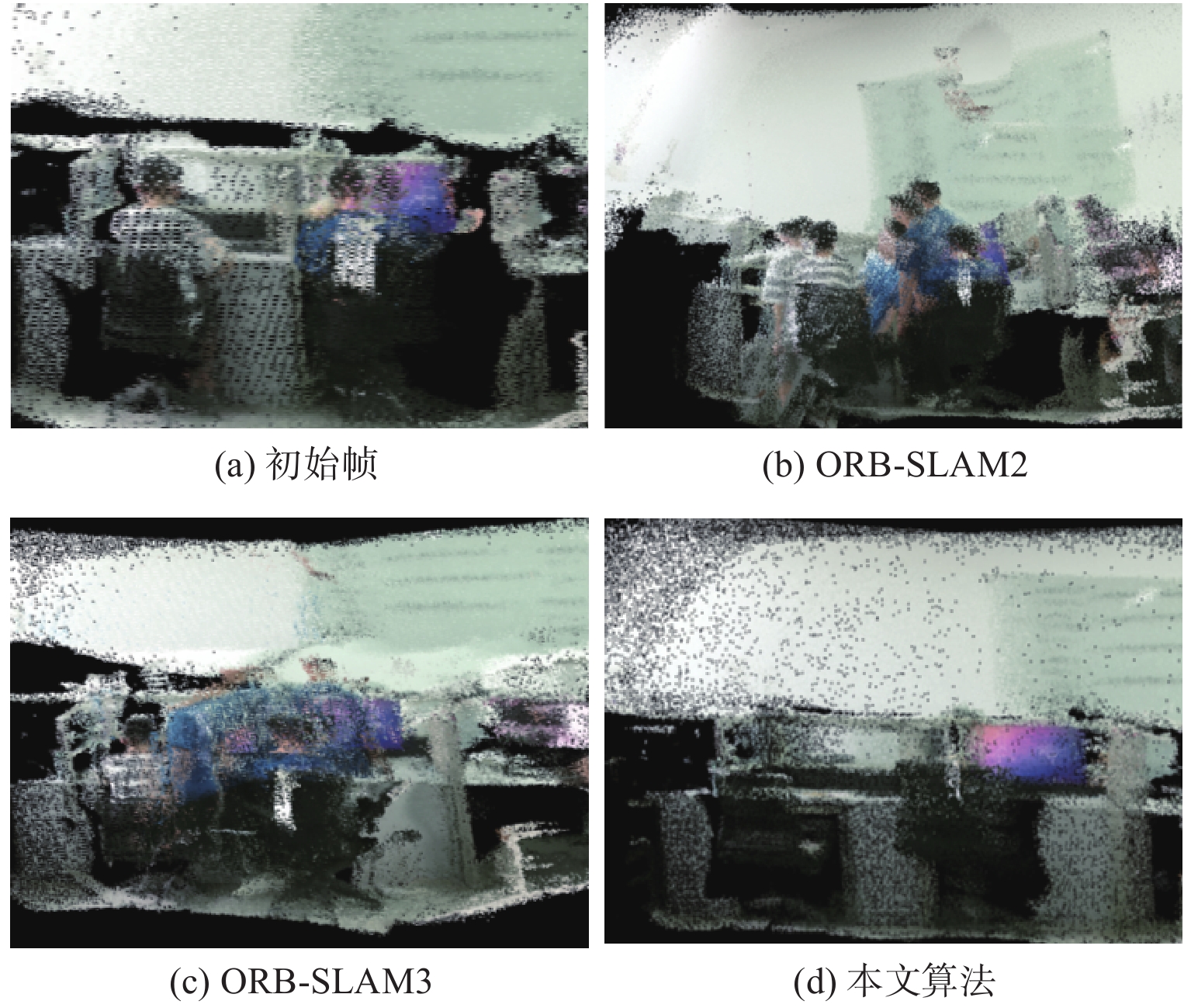

实际场景中运动物体的特征点加入到相机位姿计算中,以及静态环境特征点过度稀疏都会导致移动机器人传统视觉同步定位与地图构建(simultaneous localization and mapping, SLAM)算法在位姿估计时精度低、鲁棒性差。设计了基于分支空洞卷积的双边语义分割算法,将环境区分为潜在运动区域和静态区域;结合几何约束进行静态特征点的二次判断及对没有先验动态标记而具有移动性的特征点的判断,并在事先均匀提取的全部特征点中进行移除,只应用静态特征点求解相机位姿和构建静态环境地图。在TUM公共数据集上进行实验,验证了提出算法在动态环境中SLAM的定位精度明显优于现有其他方法。在存在运动物体的真实环境下进行建图实验,与ORB-SLAM2算法进行对比,本文算法在动态场景中构建的地图更清晰。

Abstract:The feature points of moving objects in the actual environment are added to the calculation of camera pose, and the feature points in the static environment are over-sparse, which will lead to the low accuracy and poor robustness of the traditional visual simultaneous localization and mapping (SLAM) algorithm of mobile robot in pose estimation. A bilateral semantic segmentation algorithm based on branching hole convolution was designed to divide the environment into potential motion region and static region. Combined with geometric constraints to perform secondary judgments of static feature points and judgments of mobile feature points without prior dynamic markings, the dynamic feature points were removed from all the feature points uniformly extracted in advance, and only the static feature points were used to solve the camera pose and construct the static environment map. The experiment on the TUM common dataset shows that the positioning accuracy of SLAM in dynamic environment of the proposed algorithm is obviously better than that of other existing methods. The mapping experiment was carried out in the real environment with moving objects, and compared with the ORB-SLAM2 algorithm, the map constructed in the dynamic environment was clearer.

-

引言

激光测量技术作为一种非接触式高精度测量技术,在工业生产中具有非常重要的应用价值。激光三角测距技术[1]是实现非接触式距离测量的重要手段,该方法可以快速给出目标的位移、厚度、振动、速度等丰富信息[2-6],具有测量速度快、精度高、抗干扰性能强、适用范围广等优点,已广泛应用于工业领域。

现阶段基于激光三角测量的位移传感器,大多用于量程较小的精密位移测量[7-8]。由于激光三角测量的原理限制,想实现中近距离的大量程精确位移测量会不可避免地降低输入输出的线性度、增大横向体积,一些情况下量程两端的灵敏度甚至相差数十倍,线性误差严重。而目前激光三角法测距的结构优化对线性度的研究较少,大多仅针对灵敏度或宽度进行参数或结构优化,如在参数直接对比后选择性能更好的组合[9-11];或对激光三角法的结构进行简化或改进,如在光路中添加分束镜[12-13];亦或直接在透镜后方添加反射镜[14],将像距部分进行折叠,但在中远距离及像距较小的结构中折叠效果有限。为了提高远距离准确性与仪器便携性,增加应用场景,需要合理设计激光三角测量器件的结构参数,在降低器件体积的同时保持优秀的灵敏度与线性度。

本文从理论上对激光三角法原理进行分析研究,分析了主要结构参数对器件性能的影响。同时,为提高激光三角测量的线性度及减小仪器尺寸,在接收光路中设置平面转像反射镜实现光路折叠,并利用引力搜索算法优化了系统结构参数,获得了更高的线性度,为激光三角位移传感器的性能优化提供了一种新的方案。

1 激光三角法原理

激光三角法分为直射式和斜射式两种,直射式激光三角法相比于斜射式具有结构紧凑、光斑均匀、计算简单等优点[1],本文仅针对直射式激光三角法进行讨论。图1所示为直射式激光三角测距的基本原理图。透镜光轴与激光路径形成一定夹角,激光器发出的激光在物体表面形成光斑,经被测表面散射后被透镜成像在光电探测器件中,并且随着被测物面距离的变化,光斑在线阵光电探测器件中所成像的位置也发生变化,两者一一对应。因此传感器在经过标定后,输入输出特性被确定,通过线阵光电器件接受的像素信息就可以得到所测物面的距离,本系统的线阵光电探测器件选用线阵CMOS(互补金属氧化物半导体)。

图1中,y为被测距离;∆x为像点在线阵CMOS上的位移,在图1中取左正右负;∆y为被测面的位移,根据与传感器的距离取远正近负;a为参考面的工作物距;b为与a对应的工作像距;α为激光与透镜光轴的夹角;β为线阵CMOS与透镜光轴的夹角,不宜小于30°,否则会降低线阵CMOS的接收性能,也会导致像斑的强度中心和形状中心偏移较大,从而影响光斑定位;d为透镜光轴与线阵CMOS交点到其左边缘的距离。

由透镜的成像原理可推出,要使每一个光斑都在线阵CMOS上呈清晰的像点,激光三角测量系统必须满足Scheimpflug条件[1],即透镜主面、激光和线阵CMOS的延长线交于一点。由图1中的图像关系可得:

$$ a\tan \alpha = b\tan \beta $$ (1) 根据结构关系及透镜成像原理,可得物面位移∆y与线阵CMOS上像斑位移∆x的关系:

$$ \Delta y = \frac{{a\Delta x\sin \beta }}{{b\sin \alpha - \Delta x\sin (\alpha + \beta )}} $$ (2) $$ \Delta x = \frac{{b\Delta y\sin \alpha }}{{a\sin \beta + \Delta y\sin (\alpha + \beta )}} $$ (3) 则该位移传感器在∆y位置的灵敏度为

$$ S = \frac{{\partial x}}{{\partial y}} = \frac{{ab\sin \alpha \sin \beta }}{{{{[a\sin \beta + \Delta y\sin (\alpha + \beta )]}^2}}} $$ (4) 最远量程处的灵敏度为整个仪器的最小灵敏度,可用以表征整个仪器的性能。对于参数a=300 mm,α=π/6,f=25 mm且∆x= −4 mm~4 mm的激光三角位移传感器,当只改变a、α或f中的其中一种参数时,该参数与器件最大量程处的灵敏度Smin及量程R的关系如图2~图4所示。

由图2~图4可知,成像系统的工作物距a越小、夹角α和透镜焦距f越大,器件的最小灵敏度Smin越大,测量范围越小。在激光三角系统中,灵敏度主要取决于透镜成像的垂轴放大率$ \eta=\dfrac{b}{a} $与夹角α[15]。根据透镜成像牛顿公式,a减小及f增大都使得垂轴放大率η增大,x相对y的移动会越明显;角度α越大,系统的探测范围越小,灵敏度会越高,但光斑的散射光强度会随之降低。因此,为了取得较亮的光斑图像,一般将α约束在40°以内。

线性度也是传感器静态特性的重要指标之一,表示传感器输入输出曲线与理想直线的符合程度,良好的线性度可以使器件输出分析更加方便,从而提高测量的精确度[16]。对于激光三角位移传感器来说,若近距离处与远距离处灵敏度的倍数差异过大,那么后续光斑定位等步骤也会造成相应倍数的误差,这对传感器远距离测量精度的影响是不可忽视的。激光三角位移传感器的线性度主要与夹角α有关,假设在极端条件下激光完全与透镜光轴垂直,即α=90°,则在理想成像条件下垂轴放大率恒定,输入输出完全呈直线关系,此时灵敏度S等于垂轴放大率η。随着夹角α减小,近轴与量程两端的成像放大率差异增大,特别对于量程较大的测量条件,器件量程最远与最近处在透镜平面的物距差异较大,线性度也因此急剧劣化,所以激光三角的夹角一般不小于20°且多用于量程较小的测量环境。对于确定的量程与线阵传感器件成像宽度,灵敏度S对线阵探测元件的成像长度x积分总和是一定的。因此,最小灵敏度Smin较大的结构,在总量程内的灵敏度分布更平均,线性度更佳。

2 改进结构分析

如图5所示,在透镜与被测面中间某一位置放置一块平面反射镜以折叠光路,使反光镜、透镜、线阵CMOS及激光器排列在同一横向范围内,可进一步提高器件内部空间的利用率,减小器件体积。设反射镜与透镜的距离为c,由图像分析可知,c的取值越大,对器件宽度的减小越明显;同时c的存在也会使测量距离y被折叠,从而使测量距离比未折叠前缩短$ c \cos \alpha $,器件量程的近端与远端的物距均增长$ c \cos ^{2} \alpha $。由透镜成像原理可得两端灵敏度差异会减小,但为了保持量程范围不变,需相应增大透镜焦距。

选用线阵CMOS的可成像区域长度为8 mm,则∆x的范围为(d-8, d),整个系统的其他参数都可由a、α、c、f、d来确定,由透镜成像的牛顿公式可得:

$$ \frac{1}{a}+\frac{1}{b}=\frac{1}{f} $$ (5) 参考平面距离为

$$ y=(a-c) \cos \alpha $$ (6) 器件宽度w为

$$ w=(a-c) \sin \alpha $$ (7) 反射镜距线阵CMOS的距离为(b+c),因此得到条件:

$$ b+c \leqslant(a-c) \sin \alpha $$ (8) 器件的最大量程和最小量程分别为

$$ y_{\max }=y+\Delta y_{\max }=y+\frac{a d \sin \beta}{b \sin \alpha-d \sin (\alpha+\beta)}\;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\;\; $$ (9) $$ y_{\min }=y+\Delta y_{\min }=y+\frac{a(d-8) \sin \beta}{b \sin \alpha-(d-8) \sin (\alpha+\beta)} \;\;\;\;\;\;\;$$ (10) 夹角α对线性度的影响最大[15],但夹角过大会降低接收的散射光强度并增大反射镜长度而凸出仪器,因此直接取α=40°。以a、c、d、f为优化量并合理设定取值范围,联立式(1)~式(10)后建立约束条件:

$$ \left\{\begin{array}{l} 100 \leqslant a \leqslant 800 \\ 0 \leqslant c \leqslant \dfrac{a \sin \alpha-b}{1+\sin \alpha} \\ -2 \leqslant d \leqslant 10 \\ 6 \leqslant f \leqslant 50 \\ \alpha=40^{\circ} \\ y_{\max } \geqslant 500 \\ y_{\min } \leqslant 200 \\ (a-c) \sin \alpha \leqslant 200 \end{array}\right. $$ (11) 3 算法优化过程

3.1 引力搜索算法(GSA)

引力搜索算法[17]是由伊朗的克曼大学教授RASHEDI E等学者提出的一种智能优化算法,该算法将搜索粒子看作一组在n维空间运行的物体,物体间通过万有引力相互作用吸引,适度值较大的粒子惯性质量越大,因此万有引力会促使物体们朝着质量最大的物体移动,从而逐渐逼近最优解。引力搜索算法具有较强的全局搜索能力与较快的收敛速度,很多学者也对其进行改进,进一步增强了其优化能力[18-20]。

算法首先随机生成N个n维初始粒子,设第i个粒子的坐标为Xi={xi1, xi2, …, xim, …, xin},其中xim表示第i个粒子在第m维空间中的坐标。则在t时刻或第t次迭代时,任意第j个粒子对第i个粒子在第m维的吸引力定义为

$$ {F_{ij}}^m(t) = G(t)\frac{{{M_i}(t){M_j}(t)}}{{{R_{ij}}(t) + r}}\left[ {x_j^m(t) - x_i^m(t)} \right] $$ (12) 实验证明,直接用欧氏距离Rij(t)+r代替原引力公式中的距离平方Rij2(t),可以取得更好的效果[17],其中r为一个很小的常数,防止分母为0。G(t)为t时刻的万有引力常数,随宇宙年龄的增加而减少,一般表示为$G(t)=G_0\exp(-\mathrm{\mathit{k}}t/{{{T}}})$。改变式中k的大小,可调整算法的收敛速度,k的值越大,随着算法迭代G(t)值减小的速度越慢。[xjm(t)−xim(t)]用来表征第m维度引力分量的比例大小。粒子质量Mi(t)与粒子的适应度有关,粒子适应度越大,粒子质量就越大,对其他粒子的吸引力就越强。粒子质量Mi(t)的计算公式为

$$ m_{i}(t)=\frac{f_{i}(t)-w(t)}{b(t)-w(t)} $$ (13) $$ M_{i}(t)=\frac{m_{i}(t)}{\displaystyle\sum\limits_{k=1}^{N} m_{k}(t)} $$ (14) 式中:fi(t)为t时刻第i个粒子的适应度,b(t)和w(t)分别为t时刻所有粒子中最好和最差的适应度。根据式(12)~式(14)得到每个粒子在各维度受其他粒子的合力,以及牛顿第二定律加速度$ a_{i}=F_{i} / M_{i} $,即可求得本次迭代的粒子加速度并更新粒子速度与位置。引力搜索算法的具体流程如图6所示,在达到停止条件前循环迭代,不断更新粒子信息,直到达到停止迭代条件。

3.2 优化参数分析

以a、c、d、f为优化量,分别对应于章节3.1中粒子的xi1、xi2、xi3、xi4这4个纬度坐标进行优化。此器件的优化目标是在限制器件宽度的情况下,取得更好的线性度,因此目标函数设定为最小值问题:

$$ \min f(x)=\frac{S_{\max }}{S_{\min }} $$ 式中:Smax为式(4)中测量距离最近处的灵敏度;Smin为测量距离最远处的灵敏度。根据章节1分析,量程越大或宽度越小,量程两端的灵敏度差距会越明显,因此算法会将量程逐渐逼近200 mm~500 mm,宽度逼近200 mm。根据引力搜索算法原理,编写python算法程序,设定章节3.1中初始引力常数G0=20,r=1,k=10,迭代次数为50次,初始随机粒子数为200。

本模型中有较多不等式约束,对于函数的不等式约束,使用罚函数法在目标函数中添加障碍函数使约束问题转化为无约束问题。本文采用罚函数法中的内点障碍函数法,该方法可在解空间边界筑起高墙,粒子靠近边界时会使函数值陡然增大。基于此方法,在程序中生成初始随机粒子时,检测是否符合约束条件,若不符合则重新生成。

3.3 优化结果

对迭代过程中的最佳粒子位置进行跟踪记录,每次迭代后其各维度参数及目标函数结果如图7和图8所示,各参数变量随着迭代次数的增加逐渐趋于稳定,获得所需的最佳结构参数,目标Smax/Smin值随着迭代逐步降低,表征该系统的线性度逐步提高。

参数优化结果如表1所示。

表 1 算法优化后的结构参数Table 1. Structural parameters optimized by the algorithmSmax/Smin a/mm α/(°) c/mm d/mm f/mm w/mm Smax Smin 2.357 484.19 40 173.04 6.53 25.54 200 0.040 9 0.017 4 一般激光三角法直接采用经验及一定计算来选定参数。作为对比参照,同样利用经验法确定透镜焦距f=25 mm,光轴经过线阵CMOS中间即d=4 mm,则利用量程200 mm~500 mm,宽度w=200 mm这3个约束可计算得a、α、c值。未经过算法优化的结构参数如表2所示。

表 2 未经过算法优化的结构参数Table 2. Unoptimized structural parametersSmax/Smin a/mm α/(°) c/mm d/mm f/mm w/mm Smax Smin 2.769 500.44 32.61 129.33 4 25 200 0.044 4 0.016 0 而对于非折叠激光三角结构,在相同的200 mm~500 mm量程、宽度200 mm约束下采用引力搜索算法优化其结构,以a、d、f 为优化量,计算非折叠结构的最佳参数,可优化得其参数如表3所示。

表 3 优化后的非折叠结构参数Table 3. Optimized non-folding structure parametersSmax/Smin a/mm α/(°) d/mm f/mm w/mm Smax Smin 3.62 291.12 40 6.91 18.74 200 0.050 7 0.014 0 3种结构的灵敏度与输入输出曲线如图9所示。

由表1~表3可知,在宽度相同的情况下都分别优化出最佳参数,本文参数结构与未优化的同结构相比,500 mm处的灵敏度提高了8.75%;与非折叠结构相比,500 mm处的灵敏度提高了24.29%。由图9可见,本文优化结构的量程两端灵敏度差异较小,在量程范围内的灵敏度分布更加平均,输出更接近直线。采用最小二乘法对输入输出曲线进行直线拟合,本文优化结构的非线性误差为7.43%,均方误差为9.56;未优化参数结构的非线性误差为8.90%,均方误差为11.34;而非折叠结构的非线性误差为11.40%,均方误差为14.27,线性度较差。

4 结论

本文提出了一种提高激光三角测量线性度的优化方法。在改进结构中将所有器件摆放在同一横向直线上,可以明显减少器件的横纵向宽度并提高线性度,降低远距离测量的误差。比较结果表明,相比于经验法与原非折叠结构,此优化方法有更好的理论依据和优化效果,对激光三角器件的体积与线性度具有多方面正向优化作用,具有现实意义。

本文是对激光三角结构优化的一个环节,所采用的的优化算法同样适用于其他量程或器件选型的结构优化,并可通过修改约束条件来匹配更多应用场景,具有普适性。本结构也有一定不足,所需反射镜的长度与反射镜与成像透镜距离成正比,为使结构紧凑也需对反射镜的长度做出一定约束,同时未来也将对算法的迭代速度等方面进行进一步改进。

-

表 1 实验计算机所需配置

Table 1 Required configuration of experimental computer

项目 型号 备注 CPU Inteli7-8750H Inteli7-8750H GPU NVIDIAGTX1080Ti 显存 16 GB 操作系统 Ubuntu16.04 64 位 表 2 特征点提取用时比较

Table 2 Comparison of feature point extraction time

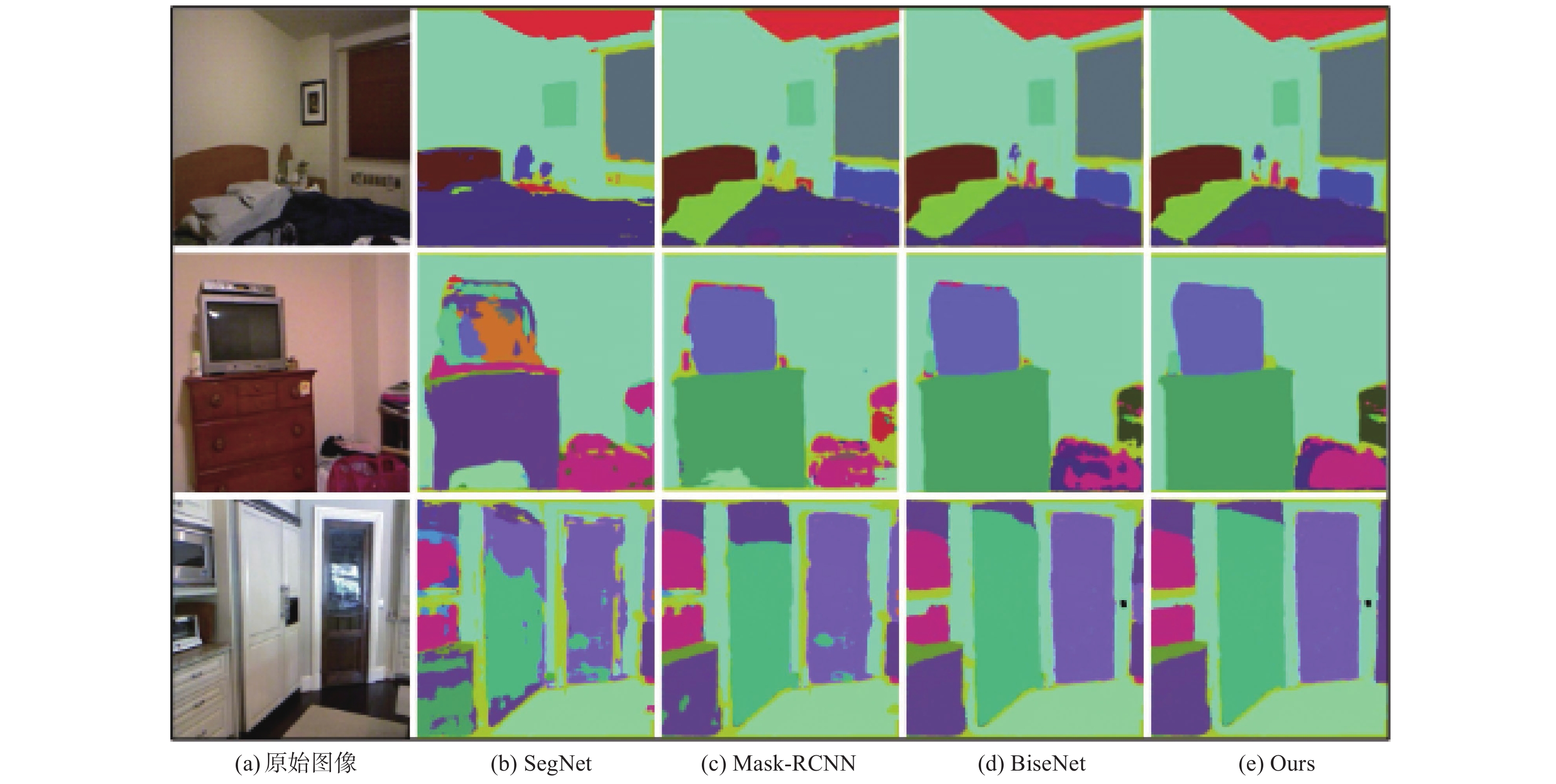

ms 图像类别 SIFT SURF ORB AKAZE 本文方法 Graffiti 808.47 789.85 195.41 378.26 228.69 Ubc 905.18 845.25 205.11 360.14 252.25 Boat 1053.31 812.54 222.67 413.38 281.44 Bikes 596.12 734.69 152.27 255.19 194.58 Leuven 618.03 681.15 174.82 269.98 211.65 表 3 各算法在Nyu-V2的平均像素准确率(MPA)和平均交并比(MIoU)

Table 3 MPA and MIoU of each algorithm in Nyu-V2

算法类别 SegNet/% Mask-RCNN/% BiseNet/% 本文方法/% MPA 72.30 73.18 73.97 74.83 MIoU 73.36 73.25 74.67 74.91 -

[1] 邹斌, 赵小虎, 尹智帅. 基于改进ORB的图像特征匹配算法研究[J]. 激光与光电子学进展,2021,58(2):96-103. ZOU Bin, ZHAO Xiaohu, YIN Zhishuai. Image feature matching algorithm based on improved ORB[J]. Laser & Optoelectronics Progress,2021,58(2):96-103.

[2] 侯志强, 王帅, 余旺盛, 等. 融合检测机制的鲁棒相关滤波视觉跟踪算法[J]. 应用光学,2019,40(5):795-804. HOU Zhiqiang, WANG Shuai, YU Wangsheng, et al. Fusion detection mechanism of robust correlation filtering visual tracking algorithm[J]. Journal of Applied Optics,2019,40(5):795-804.

[3] 胡新宇, 左韬, 张劲波, 等. 基于视觉SLAM和目标检测的语义地图构建[J]. 应用光学,2021,42(1):57-64. doi: 10.5768/JAO202142.0102002 HU Xinyu, ZUO Tao, ZHANG Jinbo, et al. Semantic SLAM based on visual SLAM and object detection[J]. Journal of Applied Optics,2021,42(1):57-64. doi: 10.5768/JAO202142.0102002

[4] 王晓华, 方琪, 王文杰. 基于网格运动统计的改进快速鲁棒特征图像匹配算法[J]. 模式识别与人工智能,2019,32(12):1133-1140. WANG Xiaohua, FANG Qi, WANG Wenjie. Image matching algorithm combining improved SURF algorithm with grid-based motion statistics[J]. Pattern Recognition and Artificial Intelligence,2019,32(12):1133-1140.

[5] TAN W, LIU H, DONG Z, et al. Robust monocular SLAM in dynamic environments [C] // IEEE International Symposium on Mixed & Augmented Reality. USA: IEEE, 2013.

[6] KLAPPSTEIN J, VAUDREY T, RABE C, et al. Moving object segmentation using optical flow and depth information[C]//Proceedings of the 3rd Pacific Rim Symposium on Advances in Image and Video Technology. Switzerland: Springer, 2009: 611-623.

[7] 林付春, 刘宇红, 周进凡, 等. 基于ORB特征的视觉里程计算法优化[J]. 激光与光电子学进展,2019,56(21):180-187. LIN Fuchun, LIU Yuhong, ZHOU Jinfan, et al. Optimization of visual odometry algorithm based on ORB feature[J]. Laser & Optoelectronics Progress,2019,56(21):180-187.

[8] PALAZZOLO E, BEHLEY J, LOTTES P, et al. ReFusion: 3D reconstruction in dynamic environments for RGB-D cameras exploiting residuals[C]//2019 IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS). USA: IEEE, 2019: 7855-7862.

[9] 王晓华, 叶振兴, 王文杰, 等. 基于多级特征融合的高精度语义分割方法[J]. 西安工程大学学报, 2021, 9(25): 1-7. WANG Xiaohua, YE Zhenxing, WANG Wenjie, et al. High precision semantic segmentation based on multi-level feature fusion[J]. Journal of Xi'an Polytechnic University, 2021, 9(25): 1-7.

[10] ZHANG L, WEI L, SHEN P, et al. Semantic SLAM based on object detection and improved octomap[J]. IEEE Access,2018,6:75545-75559. doi: 10.1109/ACCESS.2018.2873617

[11] REDMON J, FARHADI A. YOLO9000: better, faster, stronger[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition(CVPR). USA: IEEE, 2017: 7263-7271.

[12] YU C, LIU Z, LIU X J, et al. DS-SLAM: A semantic visual SLAM towards dynamic environments[C]//2018 IEEE/RSJ International Conference on Intelligent Robots and Systems. USA: IEEE, 2018: 1168-1174.

[13] BADRINARAYANAN V, KENDALL A, CIPOLLA R. Segnet: a deep convolutional encoder-decoder architecture for image segmentation[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence,2017,39(12):2481-2495. doi: 10.1109/TPAMI.2016.2644615

[14] BESCOS B, FACIL J M, CIVERA J, et al. Dyna SLAM: tracking, mapping and Inpainting in dynamic scenes[J]. IEEE Robotics and Automation Letters,2018,3(4):4076-4083. doi: 10.1109/LRA.2018.2860039

[15] HE K, GKIOXARI G, DOLLAR P, et al. Mask R-CNN[C]//International Conference on Computer Vision. USA: IEEE, 2017: 2980-2988.

[16] 姜昊辰, 刘衍青, 彭镜铨, 等. 基于语义先验和深度约束的室内动态场景RGB-DSLAM算法[J]. 信息与控制,2021,50(3):275-286. JIANG Haochen, LIU Yanqing, PENG Jingquan, et al. RGB-D SLAM algorithm based on semantic priorsand depth constraints for dynamic indoor environment[J]. Information and Control,2021,50(3):275-286.

[17] NEKRASOV V, SHEN C, REID I. Light-weight RefineNet for real-time semantic segmentation[EB/OL]. (2018-10-08)[2020-06-26].https:/arxiv.org/abs/181003272.

[18] MUR A R, TARDOS J D. ORB- SLAM2: An open- source SLAM system for monocular, stereo, and RGB-D cameras[J]. IEEE Transactions on Robotics,2017,33(5):1255-1262. doi: 10.1109/TRO.2017.2705103

[19] YU C, WANG J, PENG C, et al. BiSeNet: bilateral sgmentation network for real-time semantic segmentation[C]//European Conference on Computer Vision. Switzerland: Springer , 2018: 1-17

[20] STURM J, ENGELHARD N, ENDRES F, et al. A benchmark for the evaluation of RGB-D SLAM systems[C]//IEEE/RSJ International Conference on Intelligent Robots and Systems. USA: IEEE, 2012: 573-580.

下载:

下载:

陕公网安备 61011302001501号

陕公网安备 61011302001501号